近日特斯拉(Tesla)举行的AI Day活动中,埃隆-马斯克(Elon Musk)及多位工程师,讲解了特斯拉纯视觉方案FSD的进展、神经网络自动驾驶训练、D1芯片和Dojo超级计算机等相关信息。其中特斯拉研发的AI训练芯片D1引起了不少人的兴趣,这款芯片将用于特斯拉目前正在构建的超级计算机,旨在以更少的消耗和更少的空间提供更高的性能。

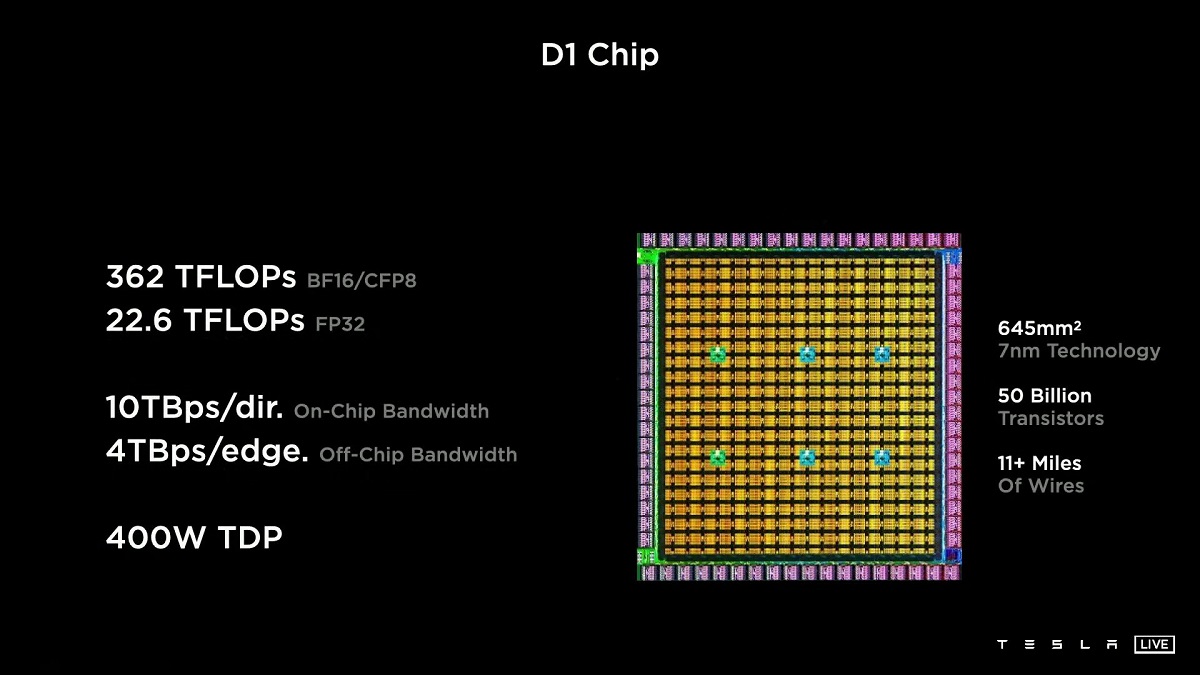

据ComputerBase报道,D1芯片是采用7nm工艺制造的定制芯片,拥有500亿个晶体管,其裸片面积为645 mm²,小于英伟达的A100(826 mm²)和AMD Arcturus(750 mm²)。其配备了354个训练节点,支持用于AI训练的各种指令,包括FP32、BFP16、CFP8、INT32、INT16和INT8。

特斯拉表示。D1芯片可以提供22.6 TFLOPS的单精度浮点运算性能,BF16/CFP8的峰值算力达到了362 TFLOPS,热设计功耗(TDP)不超过400W。对AI训练来说,可扩展性非常重要,因此通过带宽为10 TB/s的“延迟交换结构”在各个方向进行互连。D1芯片周围会有一个I/O环,有576个通道,每个通道提供112 Gbit/s带宽。同时25个D1芯片可以组成的一个训练模块,带宽达到36 TB/s,BF16/CFP8的峰值算力达到9 PFLOPS。

如果在数个机柜中部署120个训练模块(包含3000个D1芯片),就能组成ExaPOD。这是世界上首屈一指的AI训练超级计算机,超过100万个训练节点,BF16/CFP8的峰值算力达到1.1 ExaFLOPS。相比特斯拉目前基于英伟达设备构造的超级计算机,在同样成本条件下,性能提高了4倍,每瓦性能提高了1.3倍,占地面积仅为五分之一。